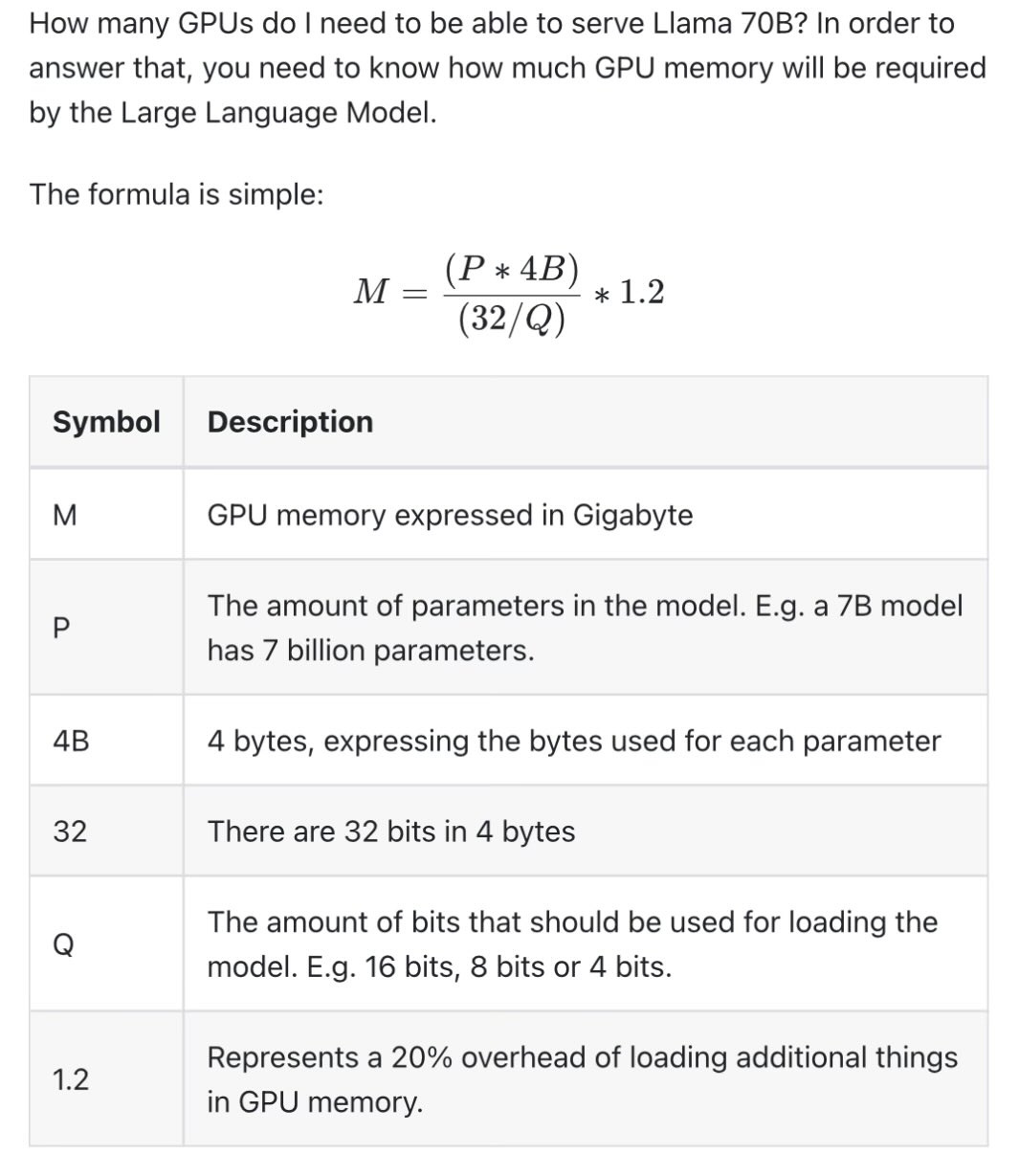

4B: 每个参数占用的字节数,这里假设每个参数占用 4 个字节(通常指 FP32 或 Float32 格式)。

Q: 加载模型时使用的位数。例如,16 位 (FP16/BF16),8 位 (INT8) 或 4 位 (INT4)。这通常称为量化。

1.2: 表示额外开销的系数,通常为 20%。这考虑了除了模型权重之外还需要加载到 GPU 显存中的其他数据,例如优化器状态、梯度等。

更多独家技术见解与热门话题讨论,尽在【开源中国 APP】,与数百万开发者一起,随时随地探索技术无限可能。

### 计算公式解析与评论**核心理解**:该公式用于估算大语言模型在GPU上的显存占用,量化是关键变量,能显著降低显存需求。**评论**: 量化线位加载直接省一半显存,炼丹党狂喜 **技术说明**: 1. 公式本质是计算模型参数总比特数经量化后的字节数,1.2倍缓冲涵盖梯度/优化器 2. FP16量化时32/Q=2,显存减半;INT4时降至1/8,但可能影响精度 3. 实际还需考虑KV缓存等推理开销,公式更适合训练场景估算

计算大模型GPU内存需求的简化公式及示例:核心公式:M = × 1.2参数说明:P = 模型参数量Q = 量化位数1.2 = 额外开销系数典型示例:1. 70B模型FP16推理: ×1.2 = 168GB2. 7B模型INT8推理: ×1.2 = 8.4GB3. 13B模型INT4推理: ×1.2 = 7.8GB注:实际需求可能因框架实现和优化有所不同。

Hermes Agent 与 OpenClaw:开源 AI 智能体的两种设计哲学

BitTorrent 创始人炮轰 Claude 团队:Vibe Coding 已走火入魔

DeepSeek 上线专家模式:产品首次引入分层设计,V4 模型传闻再起

Java 性能比我们的预期中高了四倍,gzb-one 证明了它(一份严谨的压测报告)